No âmbito do ciclo de conferências que o núcleo do Porto da ACEGE está a organizar para ajudar a pensar o futuro pós-Covid, Ana Neto, Data Protection Officer do Metropolitano de Lisboa e o padre jesuíta Afonso Seixas Nunes, mestre em direito internacional pela London School of Economics e doutorado, pela Universidade de Essex, no Reino Unido, na problemática dos sistemas de guerra autónomos, foram os oradores convidados a discutir alguns temas relacionados com “A digitalização do trabalho, os dados e a cibersegurança”. Entre os bens e os males afectos às tecnologias e, nomeadamente, à protecção ou não dos dados que, supostamente, deviam ser mesmo privados, as visões bem distintas apresentadas ajudam a uma reflexão que deve ser feita por todos nós: indivíduos e empresas

POR HELENA OLIVEIRA

Na sua apresentação, Ana Neto começou por considerar que a (r)evolução tecnológica que estamos a testemunhar consiste num desafio muito interessante, recordando que, em tempos de pandemia e encerrados nas nossas casas, a tecnologia ajudou a ultrapassar inúmeras limitações, e que, sem ela, teriam sido muitas as empresas e organizações que teriam cessado as suas operações. A seu ver, a tecnologia assume-se, neste caso (e noutros também), como um sinal de esperança, nomeadamente porque nos aproximou numa altura em que as circunstâncias obrigaram a um afastamento das nossas famílias e dos nossos locais de trabalho. Concretamente, diz, e no que respeita ao último ano, palavras como Zoom, Teams ou Webex passaram a fazer parte do nosso léxico diário permitindo, e como sabemos, atenuar a distância, não só a nível profissional, como também pessoal, imposta pelo confinamento.

A responsável pela protecção de dados do Metropolitano de Lisboa referiu ainda outros exemplos da enorme conveniência da tecnologia, como é o caso do cartão de cidadão enquanto instrumento muito útil de identificação electrónica, a par da possibilidade de se celebrar contratos ou assinar documentos importantes por via digital, o que se revelou igualmente de importância extrema ao longo da pandemia, não esquecendo também o crescimento exponencial do comércio electrónico neste mesmo período.

Entre os riscos e as oportunidades, a verdade é que, e como refere, deixou de ser possível “voltar para trás”, recordando ainda que, há uns anos, e enquanto exercia funções de adjunta do gabinete da Secretaria de Estado da Modernização Administrativa, se dizia já que todas as empresas que não estivessem informatizadas sairiam do mercado, ideia que ficou devidamente reforçada nestes tempos pandémicos. Ou, e por outras palavras, “ou existe uma adaptação às novas tecnologias que nos permita surfar a onda digital ou fica-se para trás”, com a ressalva de termos de estar naturalmente atentos e conscientes dos vários perigos que as mesmas encerram.

Todavia e assumindo agora as funções de Data Protection Officer (DPO), Ana Neto centrou a sua apresentação no RGPD [Regulamento Geral de Protecção de Dados] e na medida em que o mesmo criar um grau de consciência que, em muitos casos, não existia, sobre a cultura de percepção de dados. Para além dos chavões habituais que nos acostumámos a ouvir, de que “os dados são o novo petróleo” ou que “a informação é poder”, a verdade é que estes têm, e de forma crescente, um poder absolutamente mobilizador na actualidade, bem como um papel comercial extremamente relevante.

Ou seja, e como sublinha, estes podem ditar a sobrevivência ou não do negócio e é imperativo que se tenha consciência do Regulamento Geral de Protecção de Dados, com a privacy by design, com a segurança da informação, com todas as exigências necessárias para que quando exista uma recolha de dados, esta seja para finalidades específicas, a par de toda a confidencialidade dos mesmos.

Como afirma “há uma preocupação enorme por se proteger direitos fundamentais, como o direito à reserva da vida privada e o direito à protecção de dados, constitucionalmente garantidos na Carta dos Direitos Fundamentais” e, acrescenta, esta necessidade de cumprimento passa por, e enquanto empresas ou organizações, nos pormos nos sapatos dos titulares dos dados na medida em que “e tal como gosto de ver a minha privacidade protegida, também devo proteger a privacidade dos titulares dos dados que são tratados pela minha organização”.

Por outro lado, há que não esquecer o impacto que a “lesão” desses dados, claramente prevista na RGPD, pode trazer à organização, não só no que respeita à possibilidade de pagamento de indemnizações ou coimas em caso de infracção, mas também e não menos importante, à sua própria reputação. Ou seja, e como afirma, “não faltam campainhas para nos fazer cumprir esta regulamentação”.

Todavia e como sabemos, são vários os exemplos de “ incidentes” relacionados com a falta de segurança dos dados. Dando alguns exemplos mais mediáticos, como o que aconteceu com o Facebook, Ana Neto mencionou igualmente a perda de disponibilidade de dados por questões de segurança física, como a que aconteceu a uma das maiores empresas europeias de prestação de serviços em cloud [a francesa OVHcloud ] que, e por causa e um incêndio, viu destruído um dos seus data centers, colocando em causa as operações de várias agências governamentais, bancos, lojas, entre outros websites e comprometendo um conjunto alargado de informação.

A especialista em protecção de dados mostrou igualmente à audiência um gráfico incluído do Relatório de Riscos e Conflitos de 2021, do Centro Nacional de Cibersegurança, o qual mostra um número elevado de ciberataques, com particular relevância para o crescimento de casos de phishing e de sistemas infectados por malware. Ou seja, para Ana Neto,” todas estas questões são de importância extrema e todo o cuidado é pouco no que respeita à forma como os nossos sistemas estão seguros, bem como à formação que devemos dar às pessoas que trabalham nas organizações, pois elas próprias podem ser veículos para que situações como estas aconteçam, como por exemplo o caso de um acesso indevido por via de uma utilização negligente”.

Falando igualmente do teletrabalho – e de uma tentativa, em vários casos, de um maior controlo dos trabalhadores por parte das empresas -, a DPO do Metropolitano de Lisboa defende que deve existir algum controlo, sim, mas pela definição de objectivos e não pela criação ou implementação de ferramentas que “vigiem” o que os colaboradores estão a fazer, estejamos a falar dos websites a que acedem, do tempo em que se está parado, etc.. E mesmo sabendo-se que as organizações têm de controlar o trabalho, neste caso à distância – o que implica uma maior dificuldade e trabalho acrescido por parte das chefias que têm de organizar pessoas que estão dispersas territorialmente, e cada uma em sua casa – há que existir limites e cuidados relativos à protecção dos dados dos trabalhadores. O mesmo acontece com, por exemplo, a medição da temperatura no acesso aos locais de trabalho, ou com a testagem à Covid-19, tendo de existir uma preocupação de protecção da vida privada, de não-discriminação, e tendo em conta que estes dados devem ser tratados para fazer face a uma situação de interesse público, neste caso por causa da pandemia, ou para o cumprimento de obrigações do direito e segurança e saúde no trabalho.

“Mas sempre com confidencialidade”, rematou.

O lado negro da Inteligência Artificial e a não protecção da vida privada

Afirmando que, complementarmente à apreensão inerente à regulamentação de dados manifestada por Ana Neto na sua apresentação, o padre jesuíta Afonso Seixas Nunes diz-se mais preocupado com os vícios existentes nesta mesma regulamentação.

Contando que, até há poucos meses, exerceu funções de consultor jurídico no governo britânico para o ministério da Defesa em matéria de sistemas automatizados, e tendo em conta que a sua área de especialidade são os sistemas armados de guerra, Afonso Seixas Nunes sublinhou que qualquer um dos sistemas, quer a nível comunitário, quer a nível internacional, dependem do acesso a dados individuais ou colectivos, do uso desses dados por parte dos Estados e de como é que estes os comercializam.

E dá alguns exemplos: “o primeiro problema é o acesso dos Estados aos dados privados, sendo que o segundo é, por exemplo, o Estado português ceder dados de cidadãos portugueses a outro Estado e ainda um terceiro, que envolve a cedência de dados de cidadãos estrangeiros residentes em território português a outro Estado [um facto que, como sabemos, está a marcar a actualidade nacional], ou seja, a internacionalização dos dados. E tudo isto tem a ver não só com o poder soberano dos Estados, não só com questões de segurança interna e internacional, mas também com uma questão nova que, no meio académico, se denomina como “conflitos híbridos”.

Como explica, e se até aos anos 2000 estávamos habituados aos conflitos entre Estados, na actualidade, estes estão a combater grupos não estaduais, seja a Al-Qaeda, o ISIS ou organizações russas de hackers que tentam aceder a dados privados ou governamentais como aconteceu, por exemplo, nas últimas eleições norte-americanas.

Assim, e para “início de conversa”, Afonso Seixas Nunes confessa-se “pouco optimista” relativamente a toda esta (in)segurança de dados, dando também o exemplo do Reino Unido que, até ao ano passado, se encontrava em alerta vermelho relativamente à sua segurança interna, com a cidade de Londres a ter, em média, um ataque desmantelado uma vez por mês, sendo possível imaginar o que significa, por parte das forças policiais, o direito à vigilância e de tratamento de dados, quer de cidadãos estrangeiros, quer nacionais. E, apesar de existirem situações que não podem ser previstas – como a do carro que deliberadamente atropelou cidadãos junto ao parlamento britânico – hoje é impossível caminhar com uma arma na cidade sem se ser detectado. Ora e como diz, “isto que funciona para a segurança dos cidadãos e de outras pessoas que estejam em Londres no momento, obriga-nos a perguntar como é que o Estado tem acesso a toda esta informação?”.

E daí o tema da sua apresentação ser “O Humano fora de jogo? – O Lado Negro da IA: o risco das decisões automatizadas”.

Começando por falar no campo dos conflitos armados ou da vigilância interna dos Estados – e embora Portugal, para o bem, não tenha conflitos internos nem esteja envolvido em conflitos externos, o que justifica o não investimento em tecnologias de vigilância do território mais recentes – também o é para o mal, pois o nosso país, e no conjunto de Estados com livre acesso à internet, está em último lugar no que respeita à cibersegurança. Ou, e como afirma, “basicamente, a segurança da nossa Internet não existe, ao mesmo tempo que somos o país da União Europeia com maior cobertura do território nacional em termos de acesso à Internet e também com maior velocidade”.

Todavia, e na sua apresentação, o especialista em sistemas de guerra autónomos centrou-se não só nos drones e nas suas várias aplicações, mas também nas redes neuronais e nos algoritmos de machine learning, relacionando-os com a regulamentação de dados e com os problemas que estas tecnologias avançadas levantam tanto a nível do direito internacional, como também a nível do direito europeu, tendo como “chapéu” os riscos inerentes às decisões automatizadas ou seja, sem intervenção humana.

Recordando que, ao contrário da ideia que muitas pessoas têm de que os drones existem apenas para matar pessoas (e que só foram utilizados nesse contexto na segunda intervenção no Iraque e na intervenção no Kosovo, mas apenas para a aquisição de dados, como a vigilância de territórios ou para se ter acesso à movimentação de tropas), e tendo em conta as realidades que melhor conhece, nomeadamente a do Reino Unido e a dos Estados Unidos, Afonso Seixas Nunes explicou que estes são bastante utilizados para a vigilância da própria população ou, e por exemplo, para o que é denominado como “situações de crime impossível”, de que é exemplo a detecção de material bélico. Mas e nestes casos, a vantagem é a de que qualquer acção que o drone desempenhe é autorizada, comandada ou activada por um operador humano.

O padre jesuíta apresentou um exemplo de uma experiência que foi feita ao longo de três anos no aeroporto de Gatwick para passageiros que entravam no Reino Unido utilizando um passaporte electrónico. Como explica: “a partir da radiografia da íris, com o seu código genético não repetível, esta era transmitida às câmaras CCTV activadas na cidade de Londres e, em 48 horas, era possível estabelecer o padrão de comportamento de determinado passageiro”. Claro que, e como sublinhou, esses dados eram anónimos na medida em que eram imediatamente transformados num número, mas em apenas 48 horas era possível saber que lojas o passageiro X visitava, qual o percurso turístico que fazia, entre outras informações. Desta forma, diz, “imaginem o que é ceder esta informação, por exemplo, aos operadores turísticos de autocarros Sightseeing na cidade de Londres ou, no caso de algum passageiro suspeito, à polícia”. Ou seja, e como declara, “este é o tipo de dados que a regulamentação de dados europeia não protege e já vou explicar porquê”.

Basicamente, “e com o desenvolvimento da inteligência artificial com algoritmos de machine learning, é possível passar as actividades que inicialmente dependiam de um operador humano, até para serem autorizadas, para o próprio computador, desde a identificação até a eliminação de alvos”. E dá um exemplo: o da identificação de pessoas que tenham comprado facas num determinado dia e que podem ser sujeitas a uma revista por parte da polícia que as pode travar no meio da rua e pedir uma busca aos seus pertences.

Como afirma o especialista, na verdade isto significa “deixarmos de ter polícia com a activação de um determinado sistema”, o qual, confessa é “a menina dos seus olhos”. E qual é mesmo esse sistema?

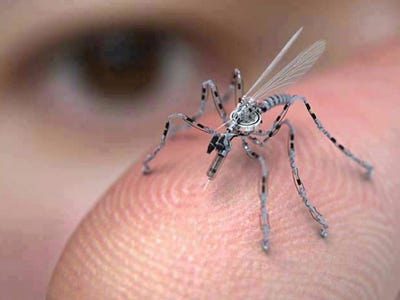

Num dos slides que partilhou com a audiência (v. imagem) , Afonso Seixas Nunes mostrou um “beedrone” (apesar de ter a aparência física de um mosquito e não de uma abelha) que passou a explicar: “ este beedrone tem uma agulha e um microprocessador debaixo das asas, recebe informação não transmitida por um operador humano, mas por um computador, o que lhe permite fazer uma identificação facial (tem uma câmara na sua parte de cima), tendo também a possibilidade de identificar o odor através da colheita do suor (embora ainda com uma taxa de erro elevadíssima acima dos 90%, não sendo por isso utilizada), o que nos dará a certeza absoluta do alvo; tem depois uma ‘injecção’, com acesso a três tipos de venenos, com um deles a provocar a simulação de um enfarte, que paralisa os músculos cardíacos e do braço, um outro que provoca cãibras nos membros inferiores, deitando a pessoa ao chão e, por último, um veneno letal em que a pessoa efectivamente morre, se estamos, por exemplo, na presença de um bombista. Este beedrone ataca na parte interior da orelha – estando as senhoras mais protegidas por causa dos cabelos – é injectado e entra rapidamente na corrente sanguínea com os efeitos a registarem-se entre os três e os cinco segundos e logo que o seu espigão entra, desfragmenta-se, não havendo possibilidade de a pessoa em causa ter acesso ao que se passou”. De tecnologia inglesa e holandesa, este beedrone é utilizado em estações de comboios, servindo para situações de bombistas ou de alerta máximo, e é activado por computador sem intervenção de um operador humano.

Num dos slides que partilhou com a audiência (v. imagem) , Afonso Seixas Nunes mostrou um “beedrone” (apesar de ter a aparência física de um mosquito e não de uma abelha) que passou a explicar: “ este beedrone tem uma agulha e um microprocessador debaixo das asas, recebe informação não transmitida por um operador humano, mas por um computador, o que lhe permite fazer uma identificação facial (tem uma câmara na sua parte de cima), tendo também a possibilidade de identificar o odor através da colheita do suor (embora ainda com uma taxa de erro elevadíssima acima dos 90%, não sendo por isso utilizada), o que nos dará a certeza absoluta do alvo; tem depois uma ‘injecção’, com acesso a três tipos de venenos, com um deles a provocar a simulação de um enfarte, que paralisa os músculos cardíacos e do braço, um outro que provoca cãibras nos membros inferiores, deitando a pessoa ao chão e, por último, um veneno letal em que a pessoa efectivamente morre, se estamos, por exemplo, na presença de um bombista. Este beedrone ataca na parte interior da orelha – estando as senhoras mais protegidas por causa dos cabelos – é injectado e entra rapidamente na corrente sanguínea com os efeitos a registarem-se entre os três e os cinco segundos e logo que o seu espigão entra, desfragmenta-se, não havendo possibilidade de a pessoa em causa ter acesso ao que se passou”. De tecnologia inglesa e holandesa, este beedrone é utilizado em estações de comboios, servindo para situações de bombistas ou de alerta máximo, e é activado por computador sem intervenção de um operador humano.

O exemplo referido por Afonso Seixas Nunes serviu para a introdução dos novos algoritmos, os quais não são “determinados” no sentido de terem um operador humano que escolhe o que o sistema faz. Ora, com a implementação das redes neuronais, diz, que são os algoritmos de machine learning e que tentam imitar o processamento do cérebro humano, apesar de e obviamente, não ser possível atingir a sua complexidade, são contudo capazes de correlacionarem dados até ao estabelecimento de padrões de semelhança, optimizando depois um resultado.

Ora, e como alerta, estes algoritmos apresentam vários problemas no que respeita à regulamentação de dados, e tanto a nível de direito internacional, como do direito europeu.

“Estes algoritmos são, em muitas circunstâncias conhecidos por algoritmos em black-box, ou seja, é impossível a um operador humano, nem que seja o melhor dos roboticistas no mundo, aceder à forma como algoritmo processou a informação, não só pela velocidade a que o algoritmo funciona, como também no que respeita ao volume de dados a que tem acesso”. Ou seja, a natureza opaca destes algoritmos traduz-se na falta de transparência de acesso a estes mesmos dados. No que respeita ao direito comunitário, diz ainda, “existe, de facto, um conjunto de protecções que são estabelecidas por lei, nomeadamente o artigo 22, que nos consagra o direito a sermos informados de uma decisão automatizada, mas a verdade é que desconhecemos qual tem sido a interpretação dos Estados sobre esta matéria”.

Afonso Seixas Nunes deu novamente o exemplo do Reino Unido que, há três anos, foi condenado a pagar milhões e milhões de compensações por acumulação de dados vigiados a privados, os quais depois vendia para pagar esta tecnologia, nomeadamente à indústria do retalho, sendo que, no caso de Portugal, não existe regulamentação neste momento para este efeito.

Outro exemplo é o da França, que proibiu a utilização de algoritmos e decisões automatizadas, enquanto a inteligência artificial não for capaz de “auto explicar” como é que o algoritmo funciona, sendo que, e mais uma vez, Portugal, não tem ainda qualquer legislação nesta matéria. E, a 27 de Maio último, o Tribunal Europeu dos Direitos do Homem condenou, quer o Reino Unido, quer a Suécia, pelas actividades de acesso e cedência de dados privados a outros Estados, sem o consentimento dos visados. Como acrescenta, “ o mesmo Tribunal estabeleceu também uma série de critérios aparentemente muito exigentes, como requisitos de necessidade e de proporcionalidade, tendo também ordenado que, em matéria de defesa, de segurança, de investigação criminal ou de investigação fiscal, estas mesmas investigações sejam autorizadas por um corpo independente de controlo”.

Mas e como também exemplifica, se imaginarmos que o Ministério Público inicia uma investigação e, portanto, tem que pedir autorização a este corpo independente para proceder a essa investigação, a verdade é que o Tribunal não regulamentou que este corpo pode fazer parte do Ministério que está a fazer esta investigação. Ou seja, o resultado é ter o Ministério Público a recorrer ao Ministério da Justiça para que seja autorizada esta investigação, o que obriga a questionar qual é a protecção ou a segurança dos privados nesta matéria. Por outro lado, diz, “também não regulamentou a destruição dos dados privados recolhidos e, ao estabelecer os critérios que o Estado tem de observar, está a autorizar tacitamente que esse mesmo Estado proceda a investigações desta matéria sem autorização dos privados”.

Em resumo, e na opinião de Afonso Seixas Nunes, estamos a caminhar para uma sociedade muitíssimo mais protegida, muitíssimo mais segura, mas em que o direito à intimidade da vida privada foi excluído das cartas constitucionais. O que constitui um complexo problema.

Para aceder à conferência na íntegra, clique aqui

Editora Executiva